LangChain అనేది పెద్ద భాషా నమూనాలు లేదా LLMలను రూపొందించడానికి లైబ్రరీలు మరియు డిపెండెన్సీలను దిగుమతి చేయడానికి ఉపయోగించే ఫ్రేమ్వర్క్. భాషా నమూనాలు సంభాషణ యొక్క సందర్భాన్ని పొందడానికి పరిశీలనగా డేటాబేస్లో డేటా లేదా చరిత్రను నిల్వ చేయడానికి మెమరీని ఉపయోగిస్తాయి. మెమొరీ అత్యంత ఇటీవలి సందేశాలను నిల్వ చేయడానికి కాన్ఫిగర్ చేయబడింది, తద్వారా వినియోగదారు ఇచ్చిన అస్పష్టమైన ప్రాంప్ట్లను మోడల్ అర్థం చేసుకోగలదు.

ఈ బ్లాగ్ LangChain ద్వారా LLMCchainలో మెమరీని ఉపయోగించే విధానాన్ని వివరిస్తుంది.

LangChain ద్వారా LLMChainలో మెమరీని ఎలా ఉపయోగించాలి?

మెమరీని జోడించడానికి మరియు LangChain ద్వారా LLMCchainలో ఉపయోగించడానికి, LangChain నుండి దిగుమతి చేసుకోవడం ద్వారా ConversationBufferMemory లైబ్రరీని ఉపయోగించవచ్చు.

LangChain ద్వారా LLMChainలో మెమరీని ఉపయోగించే ప్రక్రియను తెలుసుకోవడానికి, క్రింది గైడ్ ద్వారా వెళ్లండి:

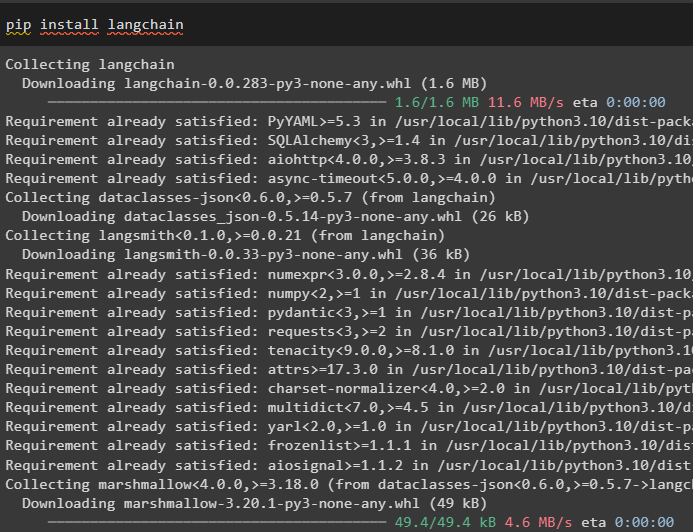

దశ 1: మాడ్యూల్లను ఇన్స్టాల్ చేయండి

మొదట, పిప్ ఆదేశాన్ని ఉపయోగించి LangChainని ఇన్స్టాల్ చేయడం ద్వారా మెమరీని ఉపయోగించే ప్రక్రియను ప్రారంభించండి:

పిప్ ఇన్స్టాల్ లాంగ్చెయిన్

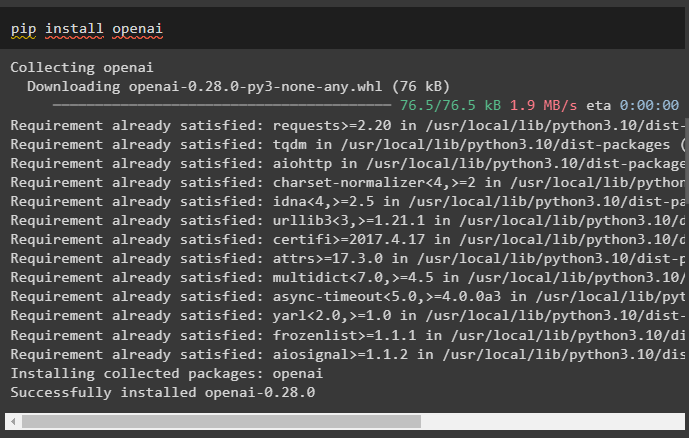

LLMలు లేదా చాట్ మోడల్లను రూపొందించడానికి దాని డిపెండెన్సీలు లేదా లైబ్రరీలను పొందడానికి OpenAI మాడ్యూల్లను ఇన్స్టాల్ చేయండి:

pip ఇన్స్టాల్ openai

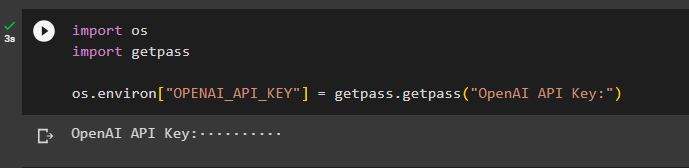

పర్యావరణాన్ని సెటప్ చేయండి OpenAI కోసం os మరియు getpass లైబ్రరీలను దిగుమతి చేయడం ద్వారా దాని API కీని ఉపయోగిస్తుంది:

మమ్మల్ని దిగుమతి చేసుకోండిగెట్పాస్ని దిగుమతి చేయండి

os.environ['OPENAI_API_KEY'] = getpass.getpass('OpenAI API కీ:')

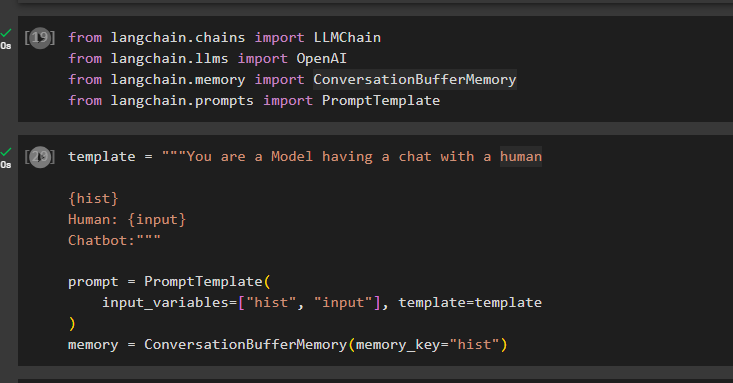

దశ 2: లైబ్రరీలను దిగుమతి చేసుకోవడం

పర్యావరణాన్ని సెటప్ చేసిన తర్వాత, LangChain నుండి ConversationBufferMemory వంటి లైబ్రరీలను దిగుమతి చేసుకోండి:

langchain.chains నుండి LLMCchain దిగుమతిlangchain.llms నుండి OpenAIని దిగుమతి చేయండి

langchain.memory దిగుమతి ConversationBufferMemory నుండి

langchain.prompts నుండి ప్రాంప్ట్ టెంప్లేట్ను దిగుమతి చేయండి

వినియోగదారు నుండి ప్రశ్నను పొందడానికి “ఇన్పుట్” మరియు డేటాను బఫర్ మెమరీలో నిల్వ చేయడానికి “హిస్ట్” వంటి వేరియబుల్లను ఉపయోగించి ప్రాంప్ట్ కోసం టెంప్లేట్ను కాన్ఫిగర్ చేయండి:

టెంప్లేట్ = '''మీరు మనిషితో చాట్ చేస్తున్న మోడల్{hist}

మానవుడు: {input}

చాట్బాట్:'''

ప్రాంప్ట్ = ప్రాంప్ట్ టెంప్లేట్(

input_variables=['hist', 'input'], template=template

)

మెమరీ = ConversationBufferMemory(memory_key='hist')

దశ 3: LLMని కాన్ఫిగర్ చేస్తోంది

ప్రశ్న కోసం టెంప్లేట్ రూపొందించబడిన తర్వాత, బహుళ పారామితులను ఉపయోగించి LLMCchain() పద్ధతిని కాన్ఫిగర్ చేయండి:

llm = OpenAI()llm_chain = LLMCచైన్(

llm=llm,

ప్రాంప్ట్=ప్రాంప్ట్,

verbose=నిజం,

జ్ఞాపకం=జ్ఞాపకం,

)

దశ 4: LLMCchainని పరీక్షిస్తోంది

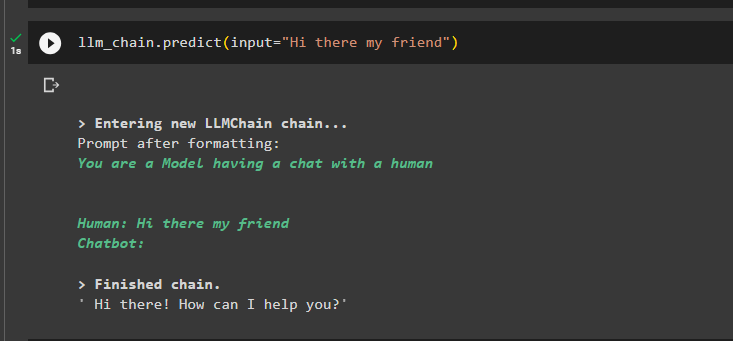

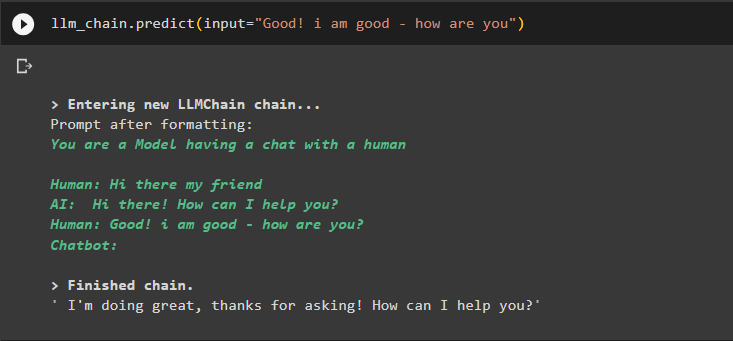

ఆ తర్వాత, పాఠ్య రూపంలో వినియోగదారు నుండి ప్రాంప్ట్ పొందడానికి ఇన్పుట్ వేరియబుల్ని ఉపయోగించి LLMCchainని పరీక్షించండి:

llm_chain.predict(input='హాయ్ దేర్ మై ఫ్రెండ్')

సందర్భాన్ని ఉపయోగించి అవుట్పుట్ను సంగ్రహించడం కోసం మెమరీలో నిల్వ చేయబడిన డేటాను పొందడానికి మరొక ఇన్పుట్ను ఉపయోగించండి:

llm_chain.predict(input='బాగుంది! నేను బాగున్నాను - ఎలా ఉన్నావు')

దశ 5: చాట్ మోడల్కు మెమరీని జోడించడం

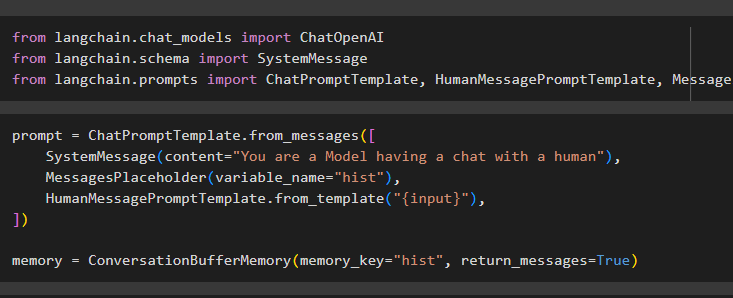

లైబ్రరీలను దిగుమతి చేయడం ద్వారా చాట్ మోడల్-ఆధారిత LLMCchainకి మెమరీని జోడించవచ్చు:

langchain.chat_models నుండి ChatOpenAIని దిగుమతి చేయండిlangchain.schema దిగుమతి SystemMessage నుండి

langchain.prompts నుండి ChatPromptTemplate, HumanMessagePromptTemplate, MessagesPlaceholder దిగుమతి

వినియోగదారు నుండి ఇన్పుట్ను సెట్ చేయడానికి విభిన్న వేరియబుల్లను ఉపయోగించి ConversationBufferMemory()ని ఉపయోగించి ప్రాంప్ట్ టెంప్లేట్ను కాన్ఫిగర్ చేయండి:

ప్రాంప్ట్ = ChatPromptTemplate.from_messages([SystemMessage(content='మీరు మనిషితో చాట్ చేస్తున్న మోడల్'),

MessagesPlaceholder(variable_),

HumanMessagePromptTemplate.from_template('{input}'),

])

మెమరీ = ConversationBufferMemory(memory_key='hist', return_messages=True)

దశ 6: LLMCchainని కాన్ఫిగర్ చేస్తోంది

విభిన్న ఆర్గ్యుమెంట్లు మరియు పారామితులను ఉపయోగించి మోడల్ను కాన్ఫిగర్ చేయడానికి LLMCchain() పద్ధతిని సెటప్ చేయండి:

llm = ChatOpenAI()chat_llm_chain = LLMCచైన్(

llm=llm,

ప్రాంప్ట్=ప్రాంప్ట్,

verbose=నిజం,

జ్ఞాపకం=జ్ఞాపకం,

)

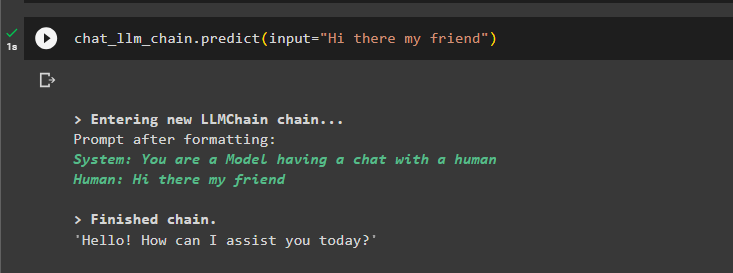

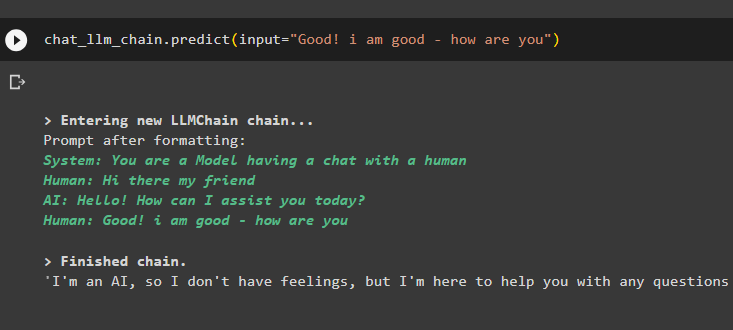

దశ 7: LLMCchainని పరీక్షిస్తోంది

ముగింపులో, ఇన్పుట్ని ఉపయోగించి LLMCchainని పరీక్షించండి, తద్వారా మోడల్ ప్రాంప్ట్ ప్రకారం టెక్స్ట్ను రూపొందించగలదు:

chat_llm_chain.predict(input='హాయ్ దేర్ మై ఫ్రెండ్')

మోడల్ మునుపటి సంభాషణను మెమరీలో నిల్వ చేసింది మరియు ప్రశ్న యొక్క వాస్తవ అవుట్పుట్కు ముందు దానిని ప్రదర్శిస్తుంది:

llm_chain.predict(input='బాగుంది! నేను బాగున్నాను - ఎలా ఉన్నావు')

లాంగ్చెయిన్ని ఉపయోగించి LLMCchainలో మెమరీని ఉపయోగించడం గురించి అంతే.

ముగింపు

LangChain ఫ్రేమ్వర్క్ ద్వారా LLMChainలో మెమరీని ఉపయోగించడానికి, మాడ్యూల్స్ నుండి డిపెండెన్సీలను పొందడానికి పర్యావరణాన్ని సెటప్ చేయడానికి మాడ్యూల్లను ఇన్స్టాల్ చేయండి. ఆ తర్వాత, మునుపటి సంభాషణను నిల్వ చేయడానికి బఫర్ మెమరీని ఉపయోగించడానికి LangChain నుండి లైబ్రరీలను దిగుమతి చేయండి. వినియోగదారు LLMCచైన్ని నిర్మించడం ద్వారా చాట్ మోడల్కు మెమరీని జోడించవచ్చు మరియు ఇన్పుట్ అందించడం ద్వారా గొలుసును పరీక్షించవచ్చు. ఈ గైడ్ LangChain ద్వారా LLMCchainలో మెమరీని ఉపయోగించే ప్రక్రియను వివరించింది.