లాంగ్చైన్ అనేది సహజ భాషా ప్రాసెసింగ్ లేదా NLP డొమైన్లోని అప్లికేషన్తో కూడిన ఫ్రేమ్వర్క్, ఇది మానవ-వంటి భాషలలో నమూనాలను రూపొందించడానికి. ఈ మోడల్లను మోడల్ నుండి సమాధానాలు పొందడానికి లేదా ఇతర మనుషుల మాదిరిగానే సంభాషణను పొందడానికి మానవులు ఉపయోగించవచ్చు. LangChain సంభాషణలో ప్రతి వాక్యాన్ని నిల్వ చేయడం ద్వారా గొలుసులను నిర్మించడానికి ఉపయోగించబడుతుంది మరియు దానిని సందర్భం వలె ఉపయోగించి మరింత పరస్పర చర్య చేస్తుంది.

ఈ పోస్ట్ LangChainలో LLM మరియు LLMCchain నిర్మాణ ప్రక్రియను వివరిస్తుంది.

LangChainలో LLM మరియు LLMCchainని ఎలా నిర్మించాలి?

LangChainలో LLM మరియు LLMCchainని నిర్మించడానికి, జాబితా చేయబడిన దశలను అనుసరించండి:

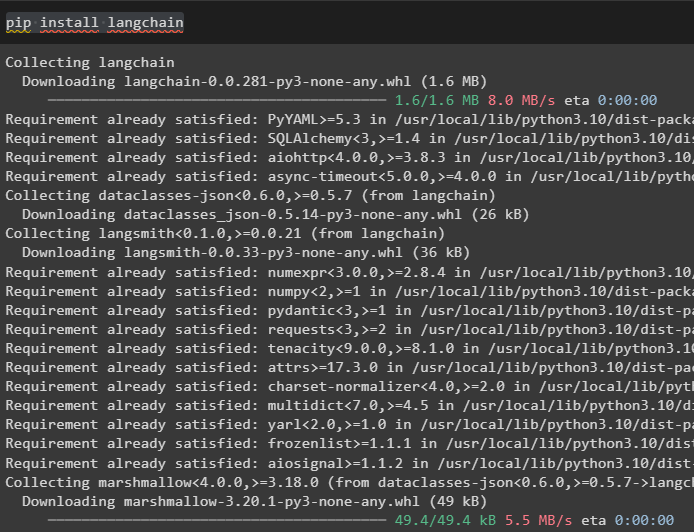

దశ 1: మాడ్యూల్లను ఇన్స్టాల్ చేయండి

ముందుగా, LangChain మాడ్యూల్ని LLMలు మరియు LLMCchain నిర్మించడానికి దాని లైబ్రరీలను ఉపయోగించడానికి ఇన్స్టాల్ చేయండి:

పిప్ ఇన్స్టాల్ లాంగ్చెయిన్

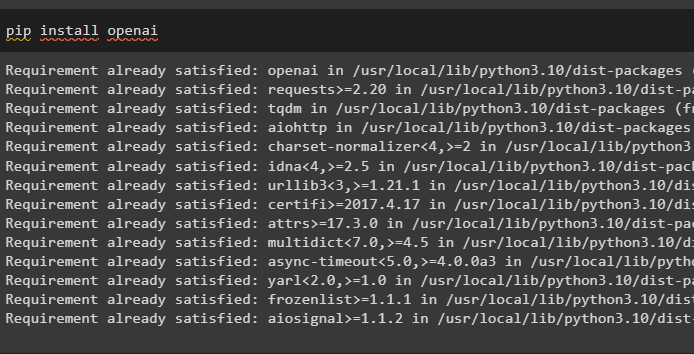

LLMలను నిర్మించడానికి అవసరమైన మరొక మాడ్యూల్ OpenAI, మరియు దీనిని పిప్ కమాండ్ ఉపయోగించి ఇన్స్టాల్ చేయవచ్చు:

pip ఇన్స్టాల్ openai

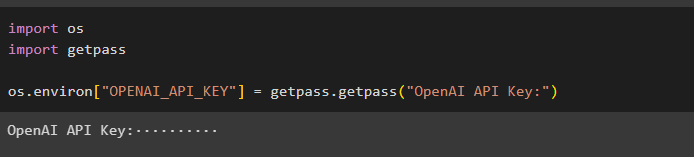

దశ 2: పర్యావరణాన్ని సెటప్ చేయండి

దాని పర్యావరణం నుండి OpenAI API కీని ఉపయోగించి పర్యావరణాన్ని సెటప్ చేయండి:

మమ్మల్ని దిగుమతి చేసుకోండిదిగుమతి getpassos.environ['OPENAI_API_KEY'] = getpass.getpass('OpenAI API కీ:')

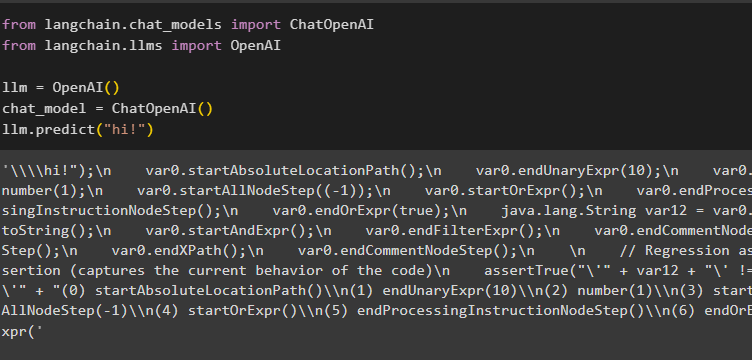

ఉదాహరణ 1: LangChainని ఉపయోగించి LLMలను రూపొందించండి

OpenAI మరియు ChatOpenAI లైబ్రరీలను దిగుమతి చేయడం మరియు llm() ఫంక్షన్ని ఉపయోగించడం ద్వారా LangChainని ఉపయోగించి లార్జ్ లాంగ్వేజ్ మోడల్లను రూపొందించడం మొదటి ఉదాహరణ:

దశ 1: LLM చాట్ మోడల్ని ఉపయోగించడం

LangChain నుండి OpenAI వాతావరణాన్ని ఉపయోగించి ఒక సాధారణ LLMని రూపొందించడానికి OpenAI మరియు ChatOpenAI మాడ్యూల్లను దిగుమతి చేయండి:

langchain.chat_models నుండి ChatOpenAIని దిగుమతి చేయండిlangchain.llms నుండి OpenAIని దిగుమతి చేయండి

llm = OpenAI()

chat_model = ChatOpenAI()

llm.predict('హాయ్!')

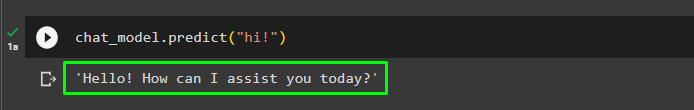

దిగువ స్క్రీన్షాట్లో ప్రదర్శించబడినట్లుగా మోడల్ “హాయ్” సమాధానంతో ప్రత్యుత్తరం ఇచ్చింది:

chat_model నుండి ప్రిడిక్ట్() ఫంక్షన్ మోడల్ నుండి సమాధానం లేదా ప్రత్యుత్తరాన్ని పొందడానికి ఉపయోగించబడుతుంది:

chat_model.predict('హాయ్!')ప్రశ్నలను అడిగే వినియోగదారు యొక్క పారవేయడం వద్ద మోడల్ ఉన్నట్లు అవుట్పుట్ ప్రదర్శిస్తుంది:

దశ 2: టెక్స్ట్ క్వెరీని ఉపయోగించడం

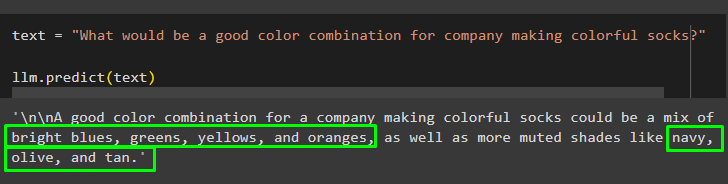

టెక్స్ట్ వేరియబుల్లో పూర్తి వాక్యాన్ని ఇవ్వడం ద్వారా వినియోగదారు మోడల్ నుండి సమాధానాలను కూడా పొందవచ్చు:

text = 'రంగు రంగుల సాక్స్లను తయారు చేసే కంపెనీకి మంచి కంపెనీ పేరు ఏమిటి?'llm.predict(టెక్స్ట్)

మోడల్ రంగురంగుల సాక్స్ కోసం బహుళ రంగు కలయికలను ప్రదర్శించింది:

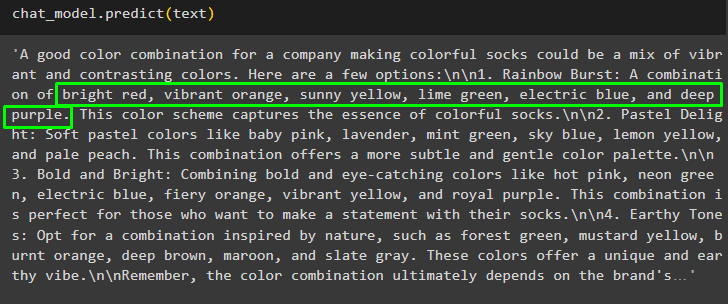

సాక్స్ కోసం కలర్ కాంబినేషన్తో ప్రిడిక్ట్() ఫంక్షన్ని ఉపయోగించి మోడల్ నుండి వివరణాత్మక ప్రత్యుత్తరాన్ని పొందండి:

chat_model.predict(టెక్స్ట్)

దశ 3: కంటెంట్తో వచనాన్ని ఉపయోగించడం

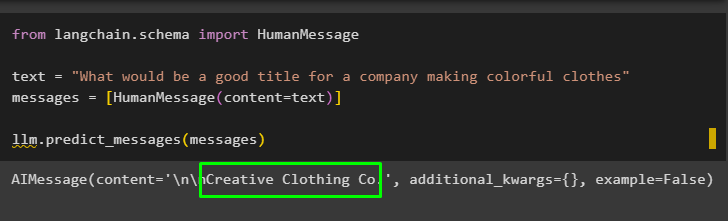

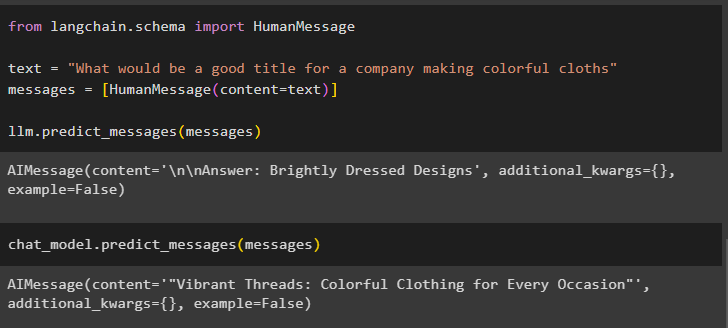

వినియోగదారు సమాధానం గురించి కొంచెం వివరణతో సమాధానాన్ని పొందవచ్చు:

langchain.schema దిగుమతి హ్యూమన్ మెసేజ్ నుండిtext = 'రంగు రంగుల దుస్తులను తయారు చేసే కంపెనీకి మంచి టైటిల్ ఏది'

సందేశాలు = [హ్యూమన్ మెసేజ్(కంటెంట్=టెక్స్ట్)]

llm.predict_messages(messages)

మోడల్ కంపెనీకి 'క్రియేటివ్ క్లాతింగ్ కో' అనే టైటిల్ను రూపొందించింది:

దాని వివరణతో పాటు కంపెనీ శీర్షికకు సమాధానాన్ని పొందడానికి సందేశాన్ని అంచనా వేయండి:

chat_model.predict_messages(messages)

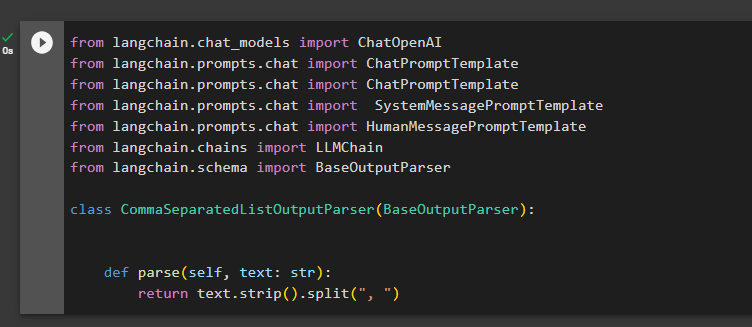

ఉదాహరణ 2: LangChainని ఉపయోగించి LLMCchainని రూపొందించండి

మా గైడ్ యొక్క రెండవ ఉదాహరణ మునుపటి ఉదాహరణ నుండి అన్ని దశలను కలపడానికి మానవ పరస్పర చర్య యొక్క ఆకృతిలో మోడల్ను పొందడానికి LLMCchainని రూపొందిస్తుంది:

langchain.chat_models నుండి ChatOpenAIని దిగుమతి చేయండిlangchain.prompts.chat నుండి ChatPromptTemplate దిగుమతి

langchain.prompts.chat నుండి ChatPromptTemplate దిగుమతి

langchain.prompts.chat దిగుమతి Langchain.prompts.chat నుండి SystemMessagePromptTemplate దిగుమతి HumanMessagePromptTemplate నుండి

langchain.chains నుండి LLMCchain దిగుమతి

langchain.schema నుండి దిగుమతి బేస్ అవుట్పుట్ పార్సర్క్లాస్ కామా వేరు చేయబడిన జాబితాఅవుట్పుట్ పార్సర్(బేస్ అవుట్పుట్ పార్సర్):

def parse(self, text: str):

text.strip().split(', ')ని తిరిగి ఇవ్వండి

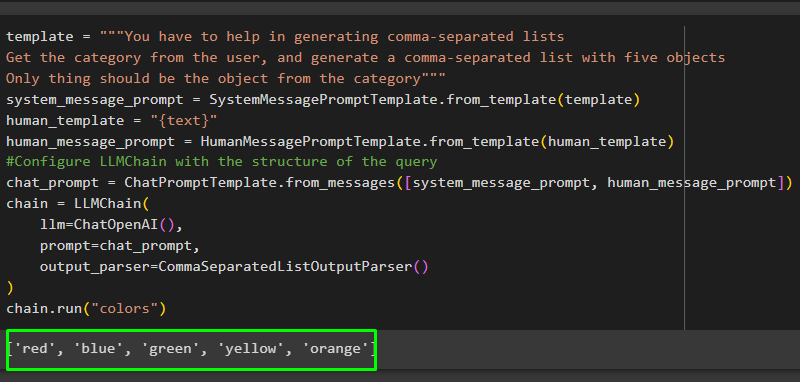

చాట్ మోడల్కు సంబంధించిన టెంప్లేట్ని దాని పని గురించి వివరణాత్మక వివరణ ఇవ్వడం ద్వారా రూపొందించండి మరియు LLM, అవుట్పుట్ పార్సర్ మరియు chat_prompt లైబ్రరీలను కలిగి ఉన్న LLMCchain() ఫంక్షన్ను రూపొందించండి:

టెంప్లేట్ = '''కామాతో వేరు చేయబడిన జాబితాలను రూపొందించడంలో మీరు సహాయం చేయాలివినియోగదారు నుండి వర్గాన్ని పొందండి మరియు ఐదు వస్తువులతో కామాతో వేరు చేయబడిన జాబితాను రూపొందించండి

''' వర్గం నుండి వస్తువు మాత్రమే వస్తువు అయి ఉండాలి

system_message_prompt = SystemMessagePromptTemplate.from_template(టెంప్లేట్)

human_template = '{text}'

human_message_prompt = HumanMessagePromptTemplate.from_template(human_template)

#ఎల్ఎల్ఎంచైన్ను ప్రశ్న నిర్మాణంతో కాన్ఫిగర్ చేయండి

chat_prompt = ChatPromptTemplate.from_messages([system_message_prompt, human_message_prompt])

చైన్ = LLMCచైన్(

llm=ChatOpenAI(),

ప్రాంప్ట్=చాట్_ప్రాంప్ట్,

output_parser=CommaSeparatedListOutputParser()

)

chain.run('రంగులు')

వర్గం ప్రాంప్ట్లో ఇచ్చిన 5 ఆబ్జెక్ట్లను మాత్రమే కలిగి ఉండాలి కాబట్టి మోడల్ రంగుల జాబితాతో సమాధానాన్ని అందించింది:

లాంగ్చెయిన్లో ఎల్ఎల్ఎమ్ మరియు ఎల్ఎల్ఎంచైన్లను నిర్మించడం గురించి అంతే.

ముగింపు

LangChainని ఉపయోగించి LLM మరియు LLMChainని నిర్మించడానికి, దాని API కీని ఉపయోగించి పర్యావరణాన్ని సెటప్ చేయడానికి LangChain మరియు OpenAI మాడ్యూల్లను ఇన్స్టాల్ చేయండి. ఆ తర్వాత, పూర్తి చాట్కి ఒకే ప్రశ్న కోసం ప్రాంప్ట్ టెంప్లేట్ని సృష్టించిన తర్వాత chat_modelని ఉపయోగించి LLM మోడల్ను రూపొందించండి. LLMCchain సంభాషణలోని అన్ని పరిశీలనల గొలుసులను నిర్మించడానికి మరియు వాటిని పరస్పర చర్య యొక్క సందర్భం వలె ఉపయోగించడానికి ఉపయోగించబడుతుంది. ఈ పోస్ట్ LangChain ఫ్రేమ్వర్క్ని ఉపయోగించి LLM మరియు LLMCchain నిర్మాణ ప్రక్రియను వివరిస్తుంది.