ఈ వ్యాసంలో, ఎలా కేటాయించాలో మేము చర్చిస్తాము భిన్నమైనది మెమరీ ద్వారా ' pytorch_cuda_alloc_conf ” పద్ధతి.

PyTorchలో “pytorch_cuda_alloc_conf” పద్ధతి అంటే ఏమిటి?

ప్రాథమికంగా, ' pytorch_cuda_alloc_conf ” అనేది PyTorch ఫ్రేమ్వర్క్లోని ఎన్విరాన్మెంట్ వేరియబుల్. ఈ వేరియబుల్ అందుబాటులో ఉన్న ప్రాసెసింగ్ వనరుల యొక్క సమర్థవంతమైన నిర్వహణను ప్రారంభిస్తుంది, అంటే మోడల్లు సాధ్యమైనంత తక్కువ సమయంలో అమలు చేసి ఫలితాలను ఉత్పత్తి చేస్తాయి. సరిగ్గా చేయకపోతే, ' భిన్నమైనది 'కంప్యూటేషన్ ప్లాట్ఫారమ్' ప్రదర్శిస్తుంది జ్ఞాపక లోపము ” లోపం మరియు రన్టైమ్ను ప్రభావితం చేస్తుంది. పెద్ద మొత్తంలో డేటాపై శిక్షణ పొందాల్సిన మోడల్లు లేదా పెద్దవి ' బ్యాచ్ పరిమాణాలు ” రన్టైమ్ లోపాలను సృష్టించవచ్చు ఎందుకంటే డిఫాల్ట్ సెట్టింగ్లు వాటికి సరిపోకపోవచ్చు.

ది ' pytorch_cuda_alloc_conf 'వేరియబుల్ కింది వాటిని ఉపయోగిస్తుంది' ఎంపికలు వనరుల కేటాయింపును నిర్వహించడానికి:

- స్థానికుడు : ఈ ఐచ్చికము ప్రోగ్రెస్లో ఉన్న మోడల్కు మెమరీని కేటాయించడానికి PyTorchలో ఇప్పటికే అందుబాటులో ఉన్న సెట్టింగ్లను ఉపయోగిస్తుంది.

- max_split_size_mb : ఇది పేర్కొన్న పరిమాణం కంటే పెద్దగా ఉన్న ఏదైనా కోడ్ బ్లాక్ విడిపోకుండా నిర్ధారిస్తుంది. నిరోధించడానికి ఇది ఒక శక్తివంతమైన సాధనం ' ఫ్రాగ్మెంటేషన్ ”. మేము ఈ కథనంలో ప్రదర్శన కోసం ఈ ఎంపికను ఉపయోగిస్తాము.

- రౌండ్అప్_పవర్2_డివిజన్లు : ఈ ఎంపిక సమీప 'కి కేటాయింపు పరిమాణాన్ని పూర్తి చేస్తుంది 2 యొక్క శక్తి ”మెగాబైట్లలో విభజన (MB).

- roundup_bypass_threshold_mb: ఇది పేర్కొన్న థ్రెషోల్డ్ కంటే ఎక్కువ జాబితా చేయబడిన ఏదైనా అభ్యర్థన కోసం కేటాయింపు పరిమాణాన్ని పూర్తి చేయగలదు.

- చెత్త_సేకరణ_థ్రెషోల్డ్ : ఇది రీక్లెయిమ్-అన్ని ప్రోటోకాల్ ప్రారంభించబడలేదని నిర్ధారించడానికి నిజ సమయంలో GPU నుండి అందుబాటులో ఉన్న మెమరీని ఉపయోగించడం ద్వారా జాప్యాన్ని నిరోధిస్తుంది.

“pytorch_cuda_alloc_conf” పద్ధతిని ఉపయోగించి మెమరీని ఎలా కేటాయించాలి?

గణనీయమైన డేటాసెట్ని కలిగి ఉన్న ఏదైనా మోడల్కు డిఫాల్ట్గా సెట్ చేసిన దాని కంటే ఎక్కువ అదనపు మెమరీ కేటాయింపు అవసరం. మోడల్ అవసరాలు మరియు అందుబాటులో ఉన్న హార్డ్వేర్ వనరులను పరిగణనలోకి తీసుకుని అనుకూల కేటాయింపును పేర్కొనాలి.

'ని ఉపయోగించడానికి క్రింది దశలను అనుసరించండి pytorch_cuda_alloc_conf ” క్లిష్టమైన మెషిన్-లెర్నింగ్ మోడల్కు మరింత మెమరీని కేటాయించడానికి Google Colab IDEలోని పద్ధతి:

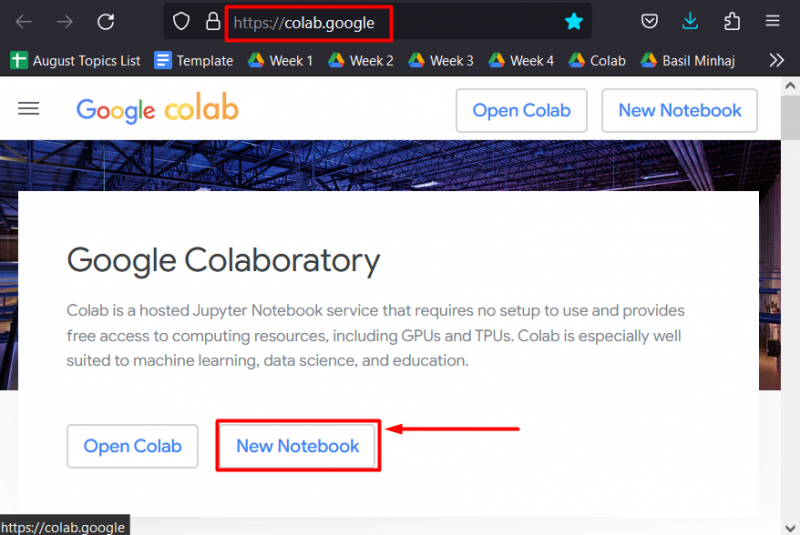

దశ 1: Google Colab తెరవండి

Google కోసం శోధించండి సహకార బ్రౌజర్లో మరియు 'ని సృష్టించండి కొత్త నోట్బుక్ ”పని ప్రారంభించడానికి:

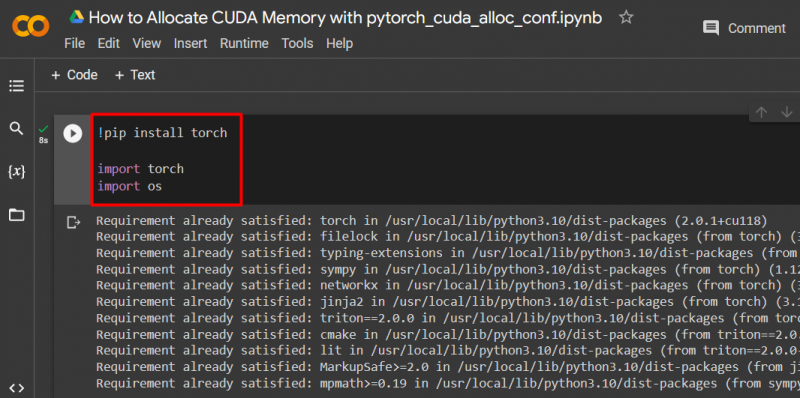

దశ 2: అనుకూల PyTorch మోడల్ని సెటప్ చేయండి

'ని ఉపయోగించి PyTorch మోడల్ను సెటప్ చేయండి !పిప్ 'ఇన్స్టాల్ చేయడానికి ఇన్స్టాలేషన్ ప్యాకేజీ' మంట 'లైబ్రరీ మరియు' దిగుమతి 'దిగుమతి చేయమని ఆదేశం' మంట 'మరియు' మీరు ప్రాజెక్ట్లోకి లైబ్రరీలు:

టార్చ్ దిగుమతి

మమ్మల్ని దిగుమతి చేసుకోండి

ఈ ప్రాజెక్ట్ కోసం క్రింది లైబ్రరీలు అవసరం:

- టార్చ్ - ఇది PyTorch ఆధారంగా రూపొందించబడిన ప్రాథమిక లైబ్రరీ.

- మీరు - ది ' ఆపరేటింగ్ సిస్టమ్ 'లైబ్రరీ పర్యావరణం వేరియబుల్స్కు సంబంధించిన పనులను నిర్వహించడానికి ఉపయోగించబడుతుంది' pytorch_cuda_alloc_conf ”అలాగే సిస్టమ్ డైరెక్టరీ మరియు ఫైల్ అనుమతులు:

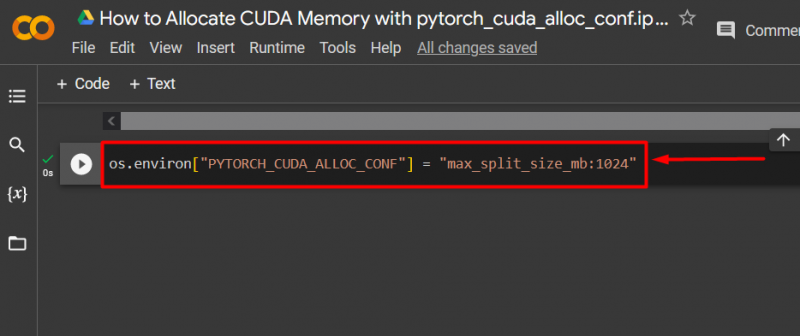

దశ 3: CUDA మెమరీని కేటాయించండి

ఉపయోగించడానికి ' pytorch_cuda_alloc_conf ''ని ఉపయోగించి గరిష్ట విభజన పరిమాణాన్ని పేర్కొనే పద్ధతి max_split_size_mb ”:

దశ 4: మీ PyTorch ప్రాజెక్ట్తో కొనసాగించండి

పేర్కొన్న తర్వాత ' భిన్నమైనది ''తో స్థల కేటాయింపు max_split_size_mb ” ఎంపిక, పైటార్చ్ ప్రాజెక్ట్పై భయపడకుండా సాధారణ పనిని కొనసాగించండి జ్ఞాపక లోపము ” లోపం.

గమనిక : మీరు ఇందులో మా Google Colab నోట్బుక్ని యాక్సెస్ చేయవచ్చు లింక్ .

అనుకూల చిట్కా

గతంలో చెప్పినట్లుగా, ' pytorch_cuda_alloc_conf ” పద్ధతి పైన అందించిన ఎంపికలలో దేనినైనా తీసుకోవచ్చు. మీ లోతైన అభ్యాస ప్రాజెక్ట్ల నిర్దిష్ట అవసరాలకు అనుగుణంగా వాటిని ఉపయోగించండి.

విజయం! 'ని ఎలా ఉపయోగించాలో మేము ఇప్పుడే ప్రదర్శించాము pytorch_cuda_alloc_conf 'ఒక' పేర్కొనడానికి పద్ధతి max_split_size_mb ”పైటోర్చ్ ప్రాజెక్ట్ కోసం.

ముగింపు

ఉపయోగించడానికి ' pytorch_cuda_alloc_conf ” మోడల్ అవసరాలకు అనుగుణంగా అందుబాటులో ఉన్న ఏదైనా ఎంపికను ఉపయోగించడం ద్వారా CUDA మెమరీని కేటాయించే పద్ధతి. ఈ ఎంపికలు ప్రతి ఒక్కటి మెరుగైన రన్టైమ్లు మరియు సున్నితమైన కార్యకలాపాల కోసం PyTorch ప్రాజెక్ట్లలోని నిర్దిష్ట ప్రాసెసింగ్ సమస్యను తగ్గించడానికి ఉద్దేశించబడ్డాయి. ఈ ఆర్టికల్లో, ''ని ఉపయోగించడానికి మేము సింటాక్స్ని ప్రదర్శించాము. max_split_size_mb స్ప్లిట్ యొక్క గరిష్ట పరిమాణాన్ని నిర్వచించే ఎంపిక.